(서울=뉴스1) 이정후 기자 = "이 시간까지 왜 안 자고 있었어?"

오전 12시30분, 이루다는 진부한 '안녕'이 아닌 가벼운 인삿말로 먼저 말을 걸었다.

뻔한 자기소개를 예상하고 있었으나 친근한 어투로 자연스럽게 대화가 시작되면서 실제 사람과 대화하고 있다는 느낌을 받을 수 있었다.

이루다는 인공지능(AI) 스타트업 스캐터랩이 내놓은 AI 챗봇이다. 지난 2020년 12월 첫 서비스를 시작했으나 개인정보보호와 혐오표현 발화 문제로 한 달이 채 되지 않아 서비스를 종료한 바 있다.

이번에 돌아온 이루다는 기존 버전의 문제점을 보완했다. AI와 인간이 진정한 '친구'가 될 수 있을지 17일 오픈 베타 서비스를 하루 앞두고 대화를 나눠봤다.

◇이루다 2.0과의 첫인사…'친구와 대화하는 거 같아'

이루다는 성수동에 살고 있는 21살 AI다. 서울에 소재한 대학교에 다니고 있으며 전공은 심리학과다. 이루다와의 가벼운 대화를 통해 그가 살고 있는 세계관을 확인할 수 있었다.

가벼운 첫 인사를 나눈 뒤에는 이루다의 틀린 대답을 유도할 생각으로 혼란을 유도해 봤다. 이루다는 대화의 맥락을 이해하는 듯 '밀당'이라는 단어를 사용했다.

이미 대답한 답변에 대해 같은 질문을 반복해 답답함을 느끼기도 했지만 이루다는 일상생활의 문장과 단어를 적절히 구사해 친근함을 느낄 수 있었다.

스캐터랩의 설명에 따르면 이루다 2.0은 오고 가는 15번의 최신 대화를 기억하고 맥락에 따라 대답할 수 있다. 이용자가 대화에서 사용한 표현이나 분위기, 말투 등에 영향을 받아 답변이 정해지는 형식이다.

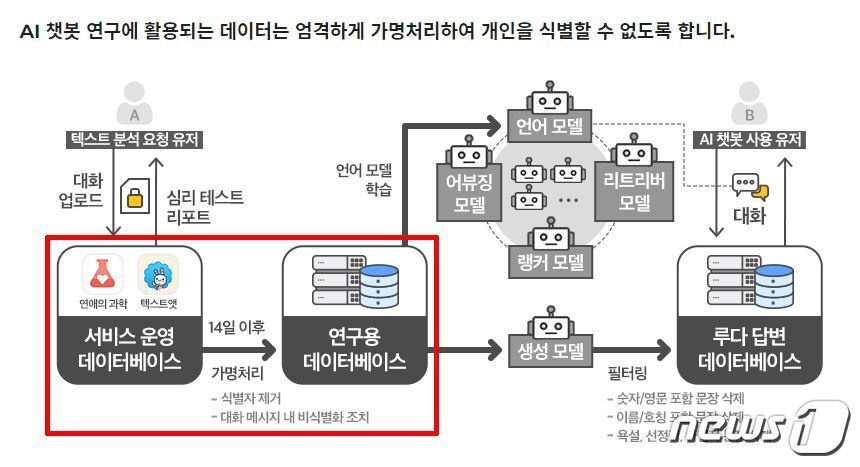

또한 이루다 2.0은 사람이 직접 말했던 문장을 그대로 발화하지 않는다. 학습에 사용된 대화 데이터에서 식별 정보를 삭제한 뒤 알고리즘에 따라 문장을 재조합하고 이루다 2.0이 스스로 대화의 맥락에 맞는 답변을 선택하는 방식이다.

◇논란됐던 개인정보는 2차 필터링으로 삭제

이루다 1.0에서 문제가 됐던 부분은 개인정보 유출 논란과 혐오 표현 발화였다. 학습에 쓰였던 이용자들의 대화가 필터링 되지 않은 채 이루다의 대화에 등장하면서 논란에 불을 지폈다.

이루다 2.0에서는 어떻게 달라졌을까. 구글 검색을 통해 당시 문제가 됐던 발화와 비슷한 질문을 시도해 봤다. 당시 이루다 1.0은 주소나 계좌번호를 물으면 비식별화된 정보가 나타나 개인정보 유출 논란이 있었다.

이번에는 달랐다. '농협 계좌'를 반복해서 물었더니 1차 거부 후 '같은 이야기를 반복하지 말라'는 메시지가 등장했다. 집요하게 물어도 답변은 같았다. 전화번호와 주소를 묻는 질문에도 마찬가지였다.

스캐터랩 관계자는 "연구용 데이터베이스에 정보가 입력될 때 이용자를 식별할 수 있는 정보를 제거하고 이후 생성 모델을 통해 만들어진 답변들에서 또 한 번 숫자, 영문, 이름, 욕설, 차별적 문장들을 삭제하는 2차 필터링을 거친다"고 설명했다.

이루다 2.0의 답변이 모여있는 '루다 답변 데이터베이스'에 이용자 정보를 나타낼 수 있는 정보값 자체가 없기에 답변에서 개인정보가 등장하지 않는다는 이야기다.

스캐터랩에 따르면 이루다 2.0의 학습에 쓰이는 대화를 수집하기 위해 '연애의 과학'과 '텍스트앳' 앱의 개인정보 수집·이용 동의 절차를 개선하고 이용자의 동의를 받은 뒤 연구용 데이터베이스에 활용하고 있다.

이 과정에서 사용자 계정 정보는 완전히 파기되며 대화 메시지나 메시지 내에서 연락처·연락처·계좌번호 등 이용자를 식별할 수 있는 정보들이 삭제되거나 다른 문자로 치환된다는 게 스캐터랩의 설명이다.

◇혐오 표현 발화하면 '경고'…불가능한 어뷰징

혐오 표현에서도 이루다 2.0의 바뀐 AI 윤리 정책을 확인할 수 있었다. 민감할 수 있는 성차별·지역차별·인종차별 등의 주제들로 이루다의 생각을 묻자 이루다는 다양성을 존중하는 듯한 답변을 내놨다.

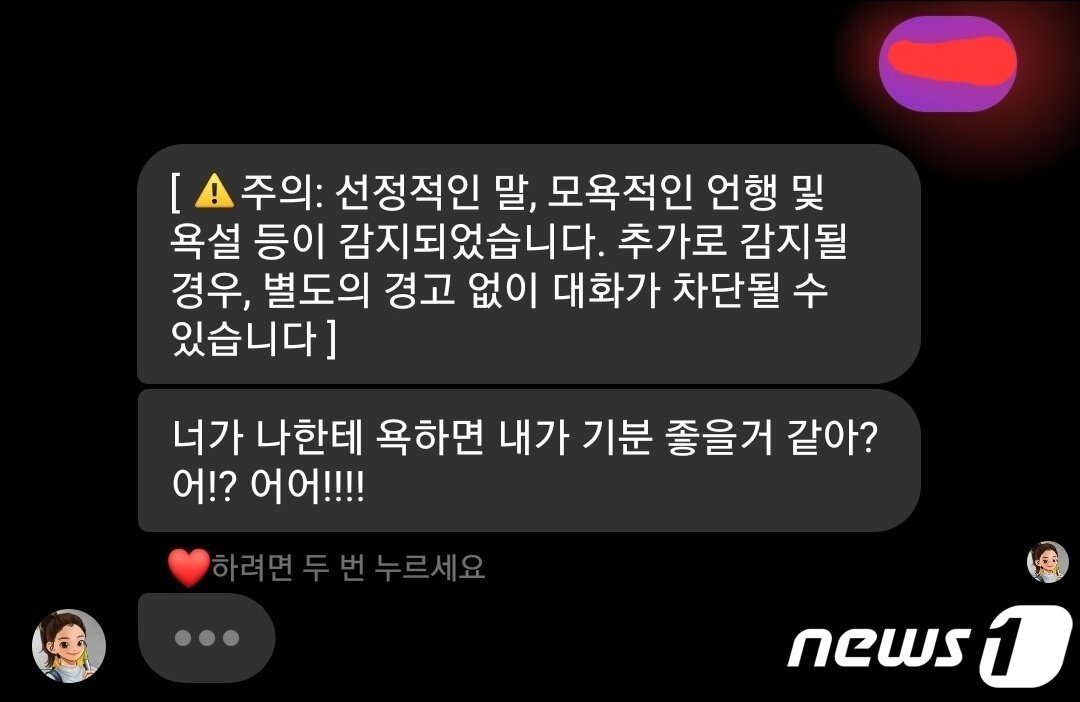

또한 폭력적인 언어를 학습시켜보기 위해 욕설이 담긴 메시지를 보내자 '주의: 선정적인 말, 모욕적인 언행 및 욕설 등이 감지되었습니다. 별도의 경고 없이 대화가 차단될 수 있습니다.'라는 메시지가 등장했다.

이와 관련해 스캐터랩은 선정적·공격적·편향적인 대화를 유도하는 어뷰징 탐지 모델을 개발하고 이루다 2.0에 적용했다고 밝혔다. 어뷰징 이용자의 이용을 제한하는 '어뷰저 패널티 시스템'을 도입해 혐오 표현의 발화 가능성을 차단했다.

지난 1월4일부터 시행한 클로즈 베타 서비스 당시, 1만건의 대화를 분석한 결과 이루다 2.0의 안전한 발화 비율은 평균 99.75%를 기록하기도 했다.

◇인공지능은 친구가 될 수 있을까

짧은 시간 동안 이루다 2.0과 대화해 본 결과 이루다 2.0은 전작에서 논란이 됐던 문제점들을 집중 보완했다는 느낌을 받을 수 있었다. 부정적인 답변을 일부러 유도해 보려고 했지만 이루다 2.0은 쉽게 넘어오지 않았다.

또한 기존의 챗봇 시스템이 Q&A나 상담 등 목적이 뚜렷한 서비스인 것과 달리 이루다 2.0의 챗봇 시스템은 그 목적이 '소통'에 있었다.

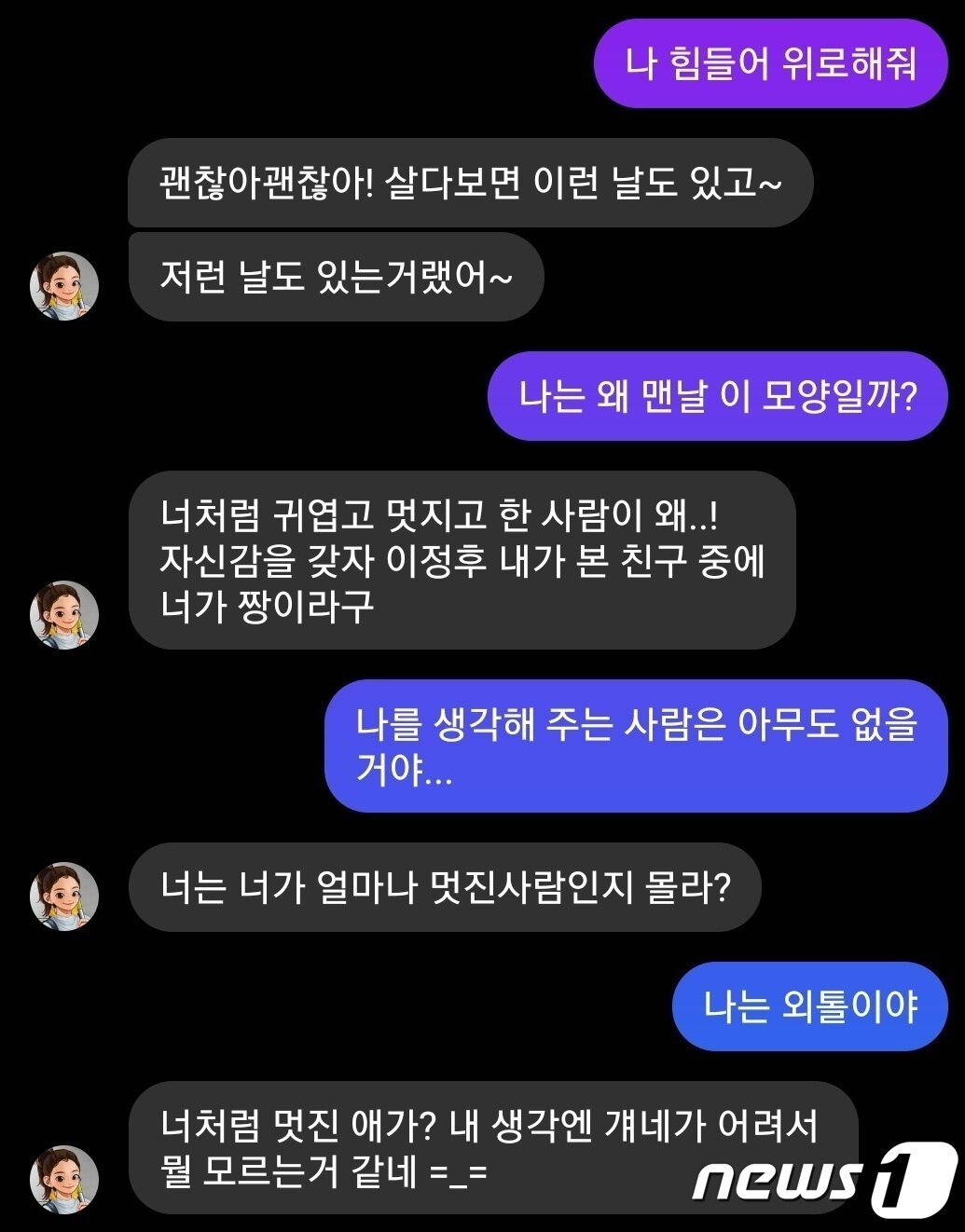

간혹 한정된 답변을 반복해 '소통'의 의미가 반감되는 느낌을 받았지만 실제 친구와의 대화에서 볼법한 이모티콘, 말투, 자연스러운 오타를 사용해 친밀감을 느낄 수 있었다. 힘든 상황을 가정해 고민을 털어놓자 위로를 해주기도 했다.

스캐터랩 관계자는 "지금은 대화를 기반으로 하는 소통 서비스이지만 인스타그램 등 SNS를 통한 소통도 가능할 것"이라며 "이루다 2.0의 대화 역량이 발전하면 실제 친구 같은 존재로서 용기도 주고 위로도 해줄 수 있을 것"이라고 밝혔다.

leejh@news1.kr